GPT4All: 로컬 환경에서 AI 활용하기

GPT4All은 다양한 언어 모델을 로컬 환경에서 손쉽게 쓰도록 돕는 오픈소스 프로젝트입니다. 인터넷이나 고사양 GPU 없이도 PC에서 LLM을 실행할 수 있으며, 개인정보 보호·데이터 주권 측면에서 클라우드 AI에 대한 대안이 됩니다. 이 글에서는 설치와 한국어 모델 추가 방법을 안내합니다.

💡 이런 분들께 추천합니다

- 로컬 PC에서 LLM을 쓰고 싶은 분

- 개인정보 유출 없이 AI를 쓰고 싶은 분

- Windows·Linux·macOS에서 GPT4All 설치·모델 추가를 하려는 분

🧩 개념 설명 / 배경 지식

GPT4All은 MIT 라이센스 오픈소스로, 수천 개 언어 모델을 다운로드해 로컬에서 실행할 수 있습니다. LocalDocs로 개인 문서를 AI와 함께 활용할 수 있고, Windows·macOS·Linux를 지원합니다. 이미 알고 있다면 다음 섹션으로 넘어가도 됩니다.

🔍 본론: GPT4All 설치 및 활용

주요 특징

- 완전한 개인정보 보호: 모든 데이터가 사용자의 로컬 기기에서만 처리됩니다

- 다양한 모델 지원: 수천 개의 언어 모델을 손쉽게 다운로드하고 사용 가능

- 크로스 플랫폼: Windows, macOS, Linux 등 주요 운영체제 지원

- LocalDocs: 개인 문서를 AI와 함께 활용할 수 있는 기능

- 오픈소스: MIT 라이센스로 제공되는 완전 오픈소스 프로젝트

🚀 설치 가이드

1. Windows PC 설치 방법

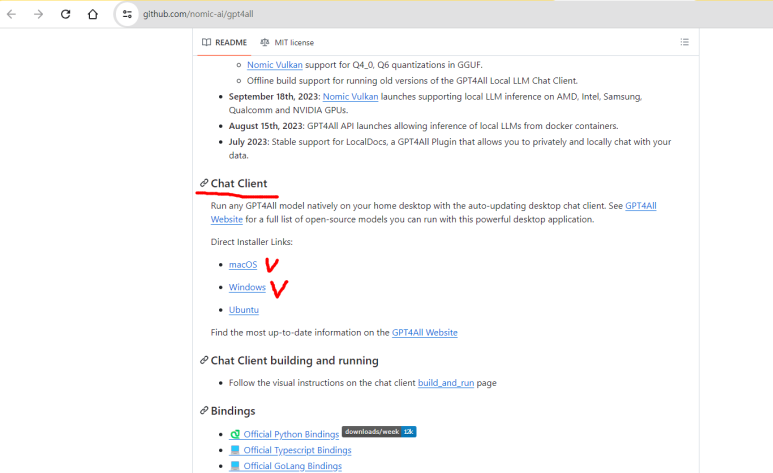

1.1 GPT4All 다운로드 및 설치

- 공식 GitHub 저장소(https://github.com/nomic-ai/gpt4all)에서 Windows 설치 파일을 다운로드합니다.

- Windows 64비트:

gpt4all-installer-win64.exe - Windows ARM:

gpt4all-installer-win64-arm.exe

- Windows 64비트:

- 설치 파일을 실행하고, 기본 모델을 선택합니다.

- 초기 사용자에게는 최상단의 Mistral OpenOrca 모델이 권장됩니다.

- 원하는 모델 옆의 “Download” 버튼을 클릭합니다.

1.2 한국어 모델 추가하기 (허깅페이스 활용)

GPT4All의 강점 중 하나는 다양한 모델을 추가로 설치할 수 있다는 점입니다. 한국어 사용자를 위해 허깅페이스에서 한국어 모델을 다운로드하는 방법을 알아보겠습니다.

- 허깅페이스 사이트에 접속합니다.

- 검색창에 “ko” 또는 “한국어”와 같은 키워드로 검색하여 한국어 모델을 찾습니다.

- 예시로 “Llama-2-ko-7B-Chat-gguf” 모델을 선택합니다.

- GGUF는 기존의 GGML 포맷의 단점을 보완한 최신 모델 형식입니다.

-

모델 파일(

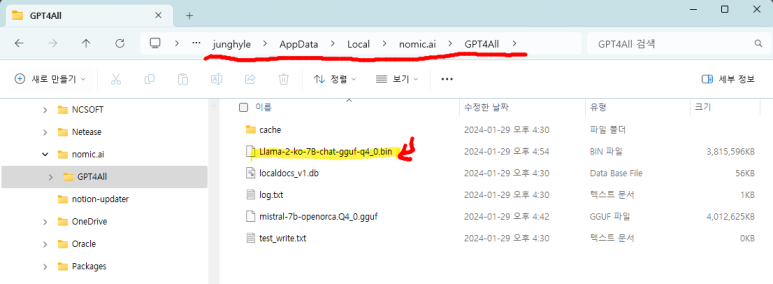

.gguf확장자)을 다운로드합니다. - 다운로드한 모델 파일을 GPT4All 모델 디렉토리에 복사합니다.

- 일반적으로

C:\Users\<사용자명>\AppData\Local\nomic.ai\GPT4All\경로에 위치합니다.

- 일반적으로

-

GPT4All 애플리케이션을 실행하고 설정(톱니바퀴 아이콘)을 클릭합니다.

-

모델 설정에서 방금 복사한 한국어 모델을 선택합니다.

-

이제 한국어 모델을 사용할 수 있습니다.

2.1 설치 옵션

Linux와 macOS 사용자는 두 가지 방법으로 GPT4All을 설치할 수 있습니다:

- 공식 설치 프로그램 사용:

- macOS:

gpt4all-installer-darwin.dmg - Ubuntu:

gpt4all-installer-linux.run

- macOS:

- GitHub 코드로 직접 설치:

# GitHub 저장소 클론

git clone https://github.com/nomic-ai/gpt4all.git

cd gpt4all

# 가상환경 설정 (권장)

python3 -m venv venv

source venv/bin/activate # Windows에서는 venv\Scripts\activate

# 필수 패키지 설치

pip install -r requirements.txt

2.2 모델 다운로드

Python 라이브러리를 통해 모델을 다운로드할 수 있습니다:

python scripts/download_model.py gpt4all-j

2.3 모델 사용하기

Python 코드를 통해 모델을 로드하고 사용할 수 있습니다:

from gpt4all import GPT4All

# 모델 로드

model = GPT4All('gpt4all-j')

# 프롬프트 입력 및 응답 생성

response = model.generate('안녕하세요, 반갑습니다!')

print(response)

📚 자주 묻는 질문 (FAQ)

Q: GPT4All은 인터넷 연결 없이도 사용할 수 있나요?

A: 네, GPT4All은 모델을 한 번 다운로드한 후에는 인터넷 연결 없이 완전히 로컬에서 실행됩니다.

Q: 어떤 종류의 파일을 LocalDocs에서 사용할 수 있나요?

A: LocalDocs는 PDF, TXT, DOCX, CSV 등 다양한 텍스트 기반 문서 형식을 지원합니다.

Q: GPT4All은 무료인가요?

A: 네, GPT4All은 완전히 무료이며 MIT 라이센스로 제공되는 오픈소스 프로젝트입니다.

Q: 개인정보가 외부로 전송되나요?

A: 아니요, GPT4All은 모든 처리를 로컬에서 수행하므로 데이터가 외부로 전송되지 않습니다.

Q: 기업에서도 사용할 수 있나요?

A: 네, MIT 라이센스이므로 상업적 용도를 포함한 다양한 환경에서 자유롭게 사용할 수 있습니다.

⚠️ 주의사항

- 모델 파일 용량이 크므로 디스크 공간을 확인하세요. GGUF 모델은 GPT4All 모델 디렉토리(

C:\Users\<사용자명>\AppData\Local\nomic.ai\GPT4All\등)에 넣어야 인식됩니다.

✅ 실습 / 적용 예시

Step 1. 공식 GitHub에서 Windows용 설치 파일(gpt4all-installer-win64.exe 등) 다운로드 후 설치. Step 2. 기본 모델 선택 후, 필요 시 허깅페이스에서 한국어 GGUF 모델을 받아 GPT4All 모델 폴더에 복사. Step 3. 설정에서 해당 모델 선택 후 채팅·LocalDocs로 활용.

🚧 트러블슈팅 / 자주 묻는 질문

(위 📚 자주 묻는 질문 (FAQ) 섹션을 참고하세요.)

- 인터넷 없이 사용 가능 여부, LocalDocs 지원 파일 형식, 무료·상업 사용, 개인정보 외부 전송 여부, 기업 사용 가능 여부 등이 정리되어 있습니다.

📝 마무리

- GPT4All으로 로컬에서 LLM을 무료·오픈소스로 사용할 수 있습니다.

- 한국어 모델은 허깅페이스에서 GGUF 파일을 받아 모델 디렉토리에 넣으면 됩니다.

- LocalDocs·다양한 모델 조합으로 문서 기반 질의응답을 이어가 보시면 됩니다.

댓글남기기